本地安装Anythingllm

场景为个人电脑,步骤如下:

1、下载 ollama ,https://ollama.com/ ,可使用导出模型代替:

2、下载 anythingllm,https://anythingllm.com/

3、使用 ollama 下载 deepseek-r1:7b 模型、nomic-embed-text:latest 模型

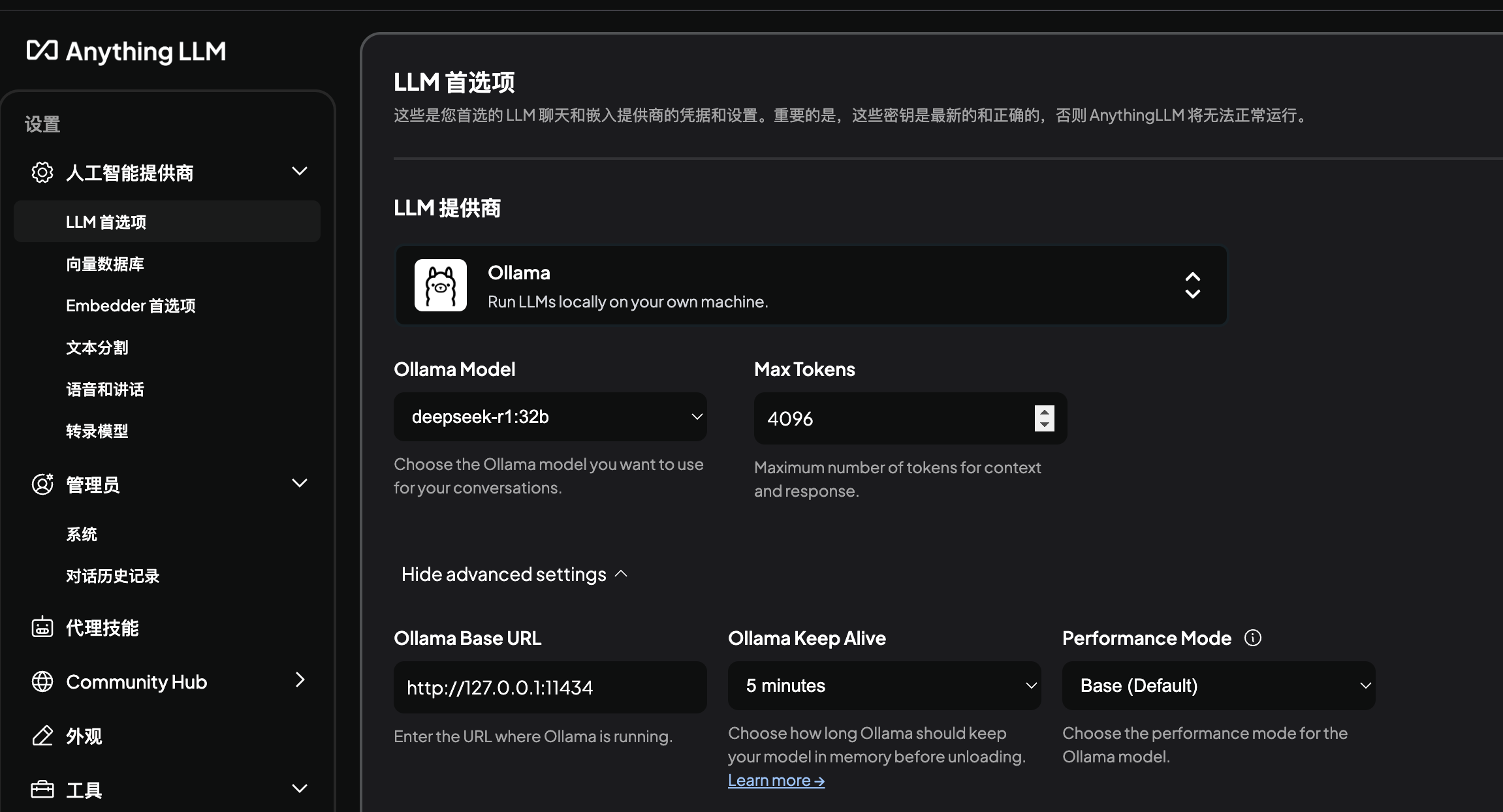

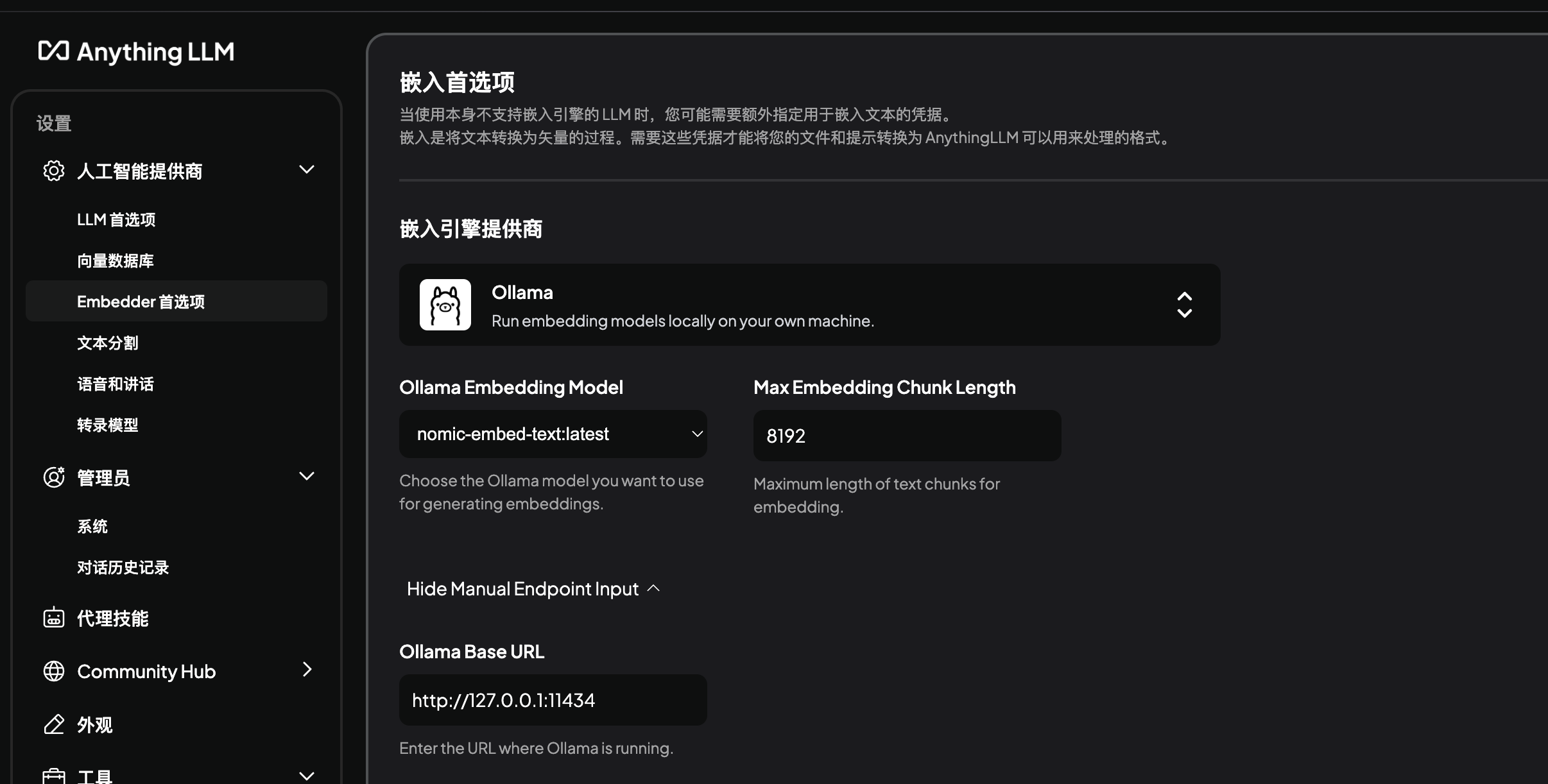

4、打开 anythingllm ,配置本地 ollama 模型:http://localhost:11434/ ,Max Token 设置:4096;嵌入选择 nomic,max chunk 设置 8192

上门安装要求

上门安装:deepseek个人本地知识库

对应配置(各版本模型对应最低配置):

1、deepseek-r1:1.5b - 4核8G

2、deepseek-r1:7b - 8核16G+8G显存

3、deepseek-r1:14b - 12核32G+16G显存

4、deepseek-r1:32b - 16核64G+24G显存

5、deepseek-r1:70b - 32核128G+48G显存(双显卡)

6、deepseek-r1:671b - 64核512G+128G显存(多显卡)

安装内容:

1、ollama + 对应模型安装

2、anythingLLM + 连接 ollama 本地模型 + 嵌入模型

实现效果:

1、可正常界面化聊天

2、可正常学习 txt、pdf、docx 等文件,通过对话模型查找对应文件

承诺:不成功捂脸走人

要求你:

有一台电脑,啥系统无所谓,但必须是64位,请自行确认,上门白跑要收20元空跑费

家里必须有网,不能太慢(要下载AI模型)

不能砍价

一口价:200元/台

限制:密云城区,远的不去配置参考:

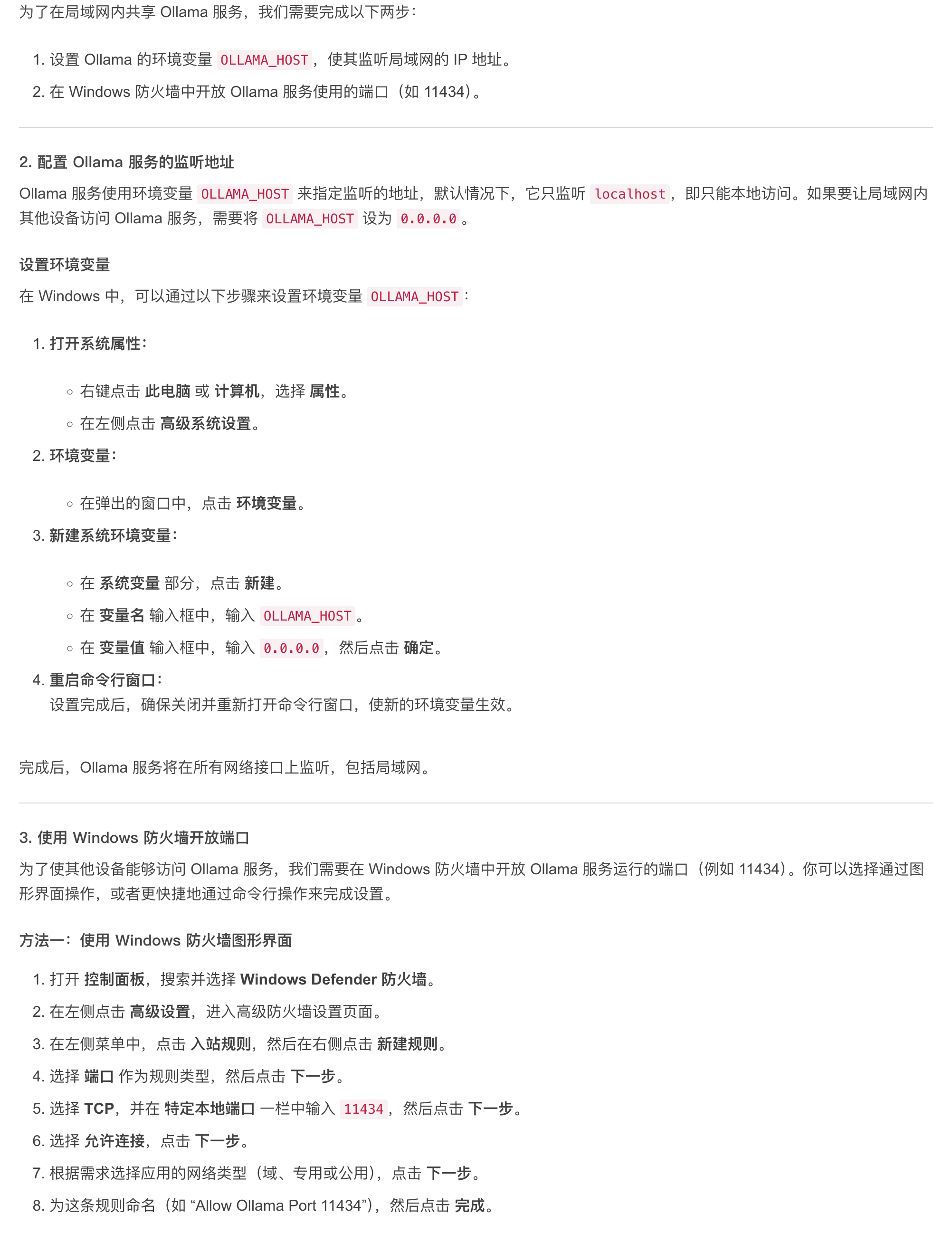

windows环境配置

MAC:

launchctl setenv OLLAMA_HOST “0.0.0.0”

iPhone:

登录国外ID,下载 misex browser 浏览器,安装 扩展,配置即可。

Android:

https://github.com/kiwibrowser/src.next/releases/tag/12867802748

下载对应apk,安装扩展配置即可。